Generell ist diese Filmprojekt darauf angelegt den Hauptanteil an Animationen mit klassischer Keyframe Animation zu lösen. Eine komplette KI Animation der einzelnen Szenen entspricht nicht meinen Vorstellung des "Look and Feels" dieses Filmes.

Wenn man sich hierzu Bespiele anschaut, speziell über die momentan bekanntesten Tools wie Runway GEN2 , Pika Labs und neuerdings PixeVerse AI so gibt es doch noch erhebliche Probleme damit ein sogenanntes Full Movie zu drehen. Meistens sind diese Tools gut zu verwenden für Trailer und auch für Short Movies, für längere und komplexere Szenen eher noch nicht, da man auch nur max 16 Sekunden am Stück generieren kann. Es gibt zwar einen Trick mit einem "Last Frame Cut" und einem damit weiter generieren, aber das macht das Endergebnisse nicht besser.

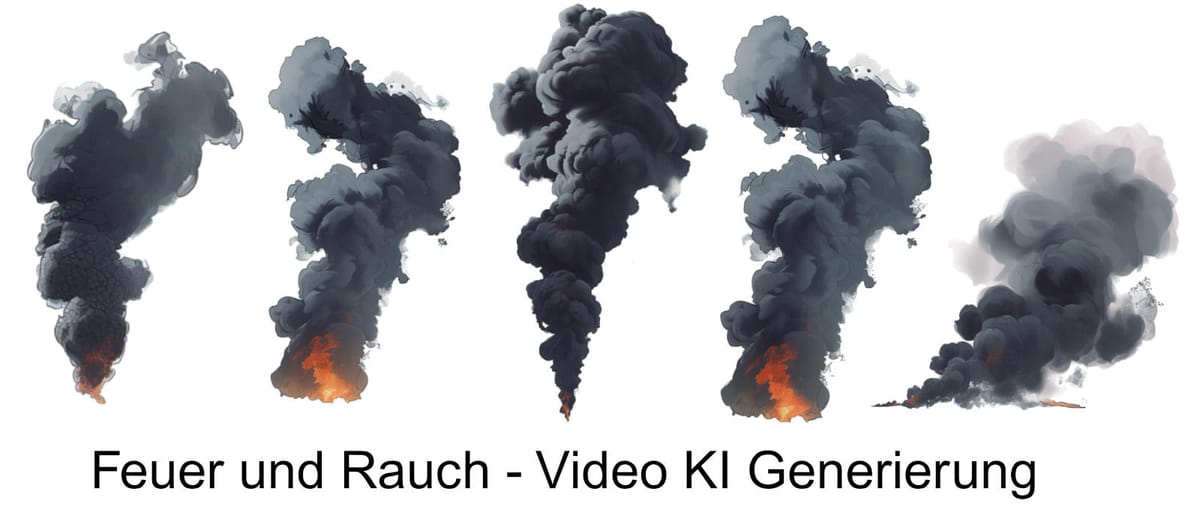

Ließen sich diese Tools denoch für dieses Projekt verwenden ? Es gibt natürlich Szenen, oder Elemente von Szenen, die sich ganz gut dafür eignen würden und die wiederum für Key Frame Animation zu aufwendig wären. Dazu gehören vor allen Dingen, atmosphärische Effekte wie Feuer und Rauch, wabernder Nebel, evtl auch Regen.

In Midjourney oder auch in anderen Tools werden dafür Stills vor einem weißen oder schwarzen Background erstellt, die dann mit diesen KI Tools einfach in Bewegung gesetzt werden. Das funktioniert bei Feuer und Rauch schon wirklich ganz gut; im Gegensatz zu Menschen und Tier, wie man an den Beispielen sehen kann.

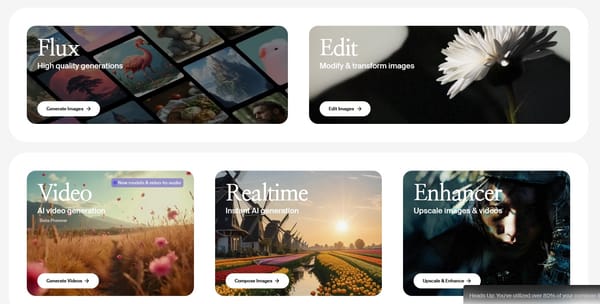

Meine weitergehende Erfahrung ist diese, auch in Hinblick auf den Low Budget Aspekt des Projekts; das Pixe Verse AI momentan in Hinblick auf den Workflow die Nase vorne hat. Runway GEN 2 und Pika Labs sind kostenpflichtig (beide um die 10 - 11 Euro im Monat) Beide kann man eine gewisse Zeit frei benutzen, haben aber ein Wasserzeichen an der Seite. Das würde allerdings beim Maskieren später automatisch verschwinden. Runway GEN 2 hat ein internes Maskierungstool. Diese Möglichkeit nützt hier momentan leider nicht viel, da ich den Alphakanal beim Konvertieren in ein Mpeg4 nicht erhalte und somit das jeweilige Objekt nicht freigestellt wird.

PIXE VERSE AI ist nach ersten Test zumindest für den Raw Cut erste Wahl, weil es komplett frei zu benutzen ist und auch kein Wasserzeichen verwendet. Nachteile gibt es natürlich, die im Gegensatz zu Runway GEN 2 und Pika Labs dahingehend liegen, das man nur ein 4 sekündigen Clip generieren kann. Das bedeutet speziell bei Szenen die länger sind, das man im Falle von Rauchschwaden immer den letzten Clip des Clips seperieren muß und ihn dann wieder von vorne bearbeiten lässt, so das sich die Szenen künstlich auseinanderziehen.

Eine weitere Erfahrung die man aus dem bloßen KI Generieren von Bildmaterial (Image to Video) ausserdem ziehen kann, ist die, dass mit weiteren Verlauf die Qualität des Bilder verschwindet. Die Pixel ziehen sich ausseinander und werden blurry. Ich denke das dies Problem die typischen Anfangsprobleme der KI Video-Bild-Generierung an sich sind und sich im weiteren Verlauf der Entwicklung verflüchtigen werden.