Eines der wichtigsten Elemente in diesem Projekt sind natürlich die Animationen. Jetzt ist es mir endlich gelungen kleinere Animationssequenzen in eine vollständige 3d Szenen zu integrieren. Das ist allerdings noch lange nicht die eierlegende Wollmilchsau, was das Problem der Figurenanimation auf Dauer lösen wird, denn dieser Vorgang wird weiterhin mit klassischer Keyframeanimtion durchzuführen sein.

Generell muß man unterscheiden zwischen Primärer und Sekundärer Animation. Der Unterschied ist dabei gravierend.

Die primäre Animation ist meist den Hauptfiguren zuzuordnen. Diese sollten also klassisch in 3d aufgebaut werden und dann mit einem Bone Skellet geriggt werden.

Bei der Sekundäranimation sollte man sich darüber im Klaren sein, ab wann es sinnvoll ist darüber nachzudenken, ob der Zeitaufwand eines Figuren Rigs sinnvoll ist. Oder ob es nicht effektiver wäre, kurze Bewegungsabschnitte die mehr im Hintergrund sich abspielen (z.b Strassenszenen mit vielen Figuren im Hintergrund) über kurze KI Clips ablaufen zu lassen.

Dafür muß man am Ende "nur" noch den erstellten Clip mit der Figur, in die 3d Szenen als Material einfügen. Es wird also, wie auch bei einem simplen Bild, das MP4 Mov. in einen Farbkanal und einen Alphakanal geladen, in dem dieser dort, dann aber nicht statisch, sondern als Film in der späteren Animation ablaufen kann.

Ich hatte schon länger mit KI Videogeneratoren wie Pix Vers, Luma Ai, Kling und natürlich Minimax herumprobiert und dabei unterschiedliche, schon recht vernünftige Ergebnisse bekommen.

Hier mal das Beispiel eines Walk Cycle des Characters Grand Ma Marie. Die Problematik ist nur die, wo genau diese Sequenzen einzusetzen sind, da diese am Ende nur simple Projektionen auf einer 3d Fläche sind und ähnlich wie ein Bild in Wirklichkeit nur flach sind. Würde sich also die Kamera versuchen zusätzlich um die Figur zu drehen würde man den Fake sehen. Ausserdem war es und ist es nicht ganz so einfach die Figur freizustellen, da die Mp4 Seguenzen kein freigestellten Alphakanal produzieren, sondern nur eine Figur vor weißem Hintergrund.

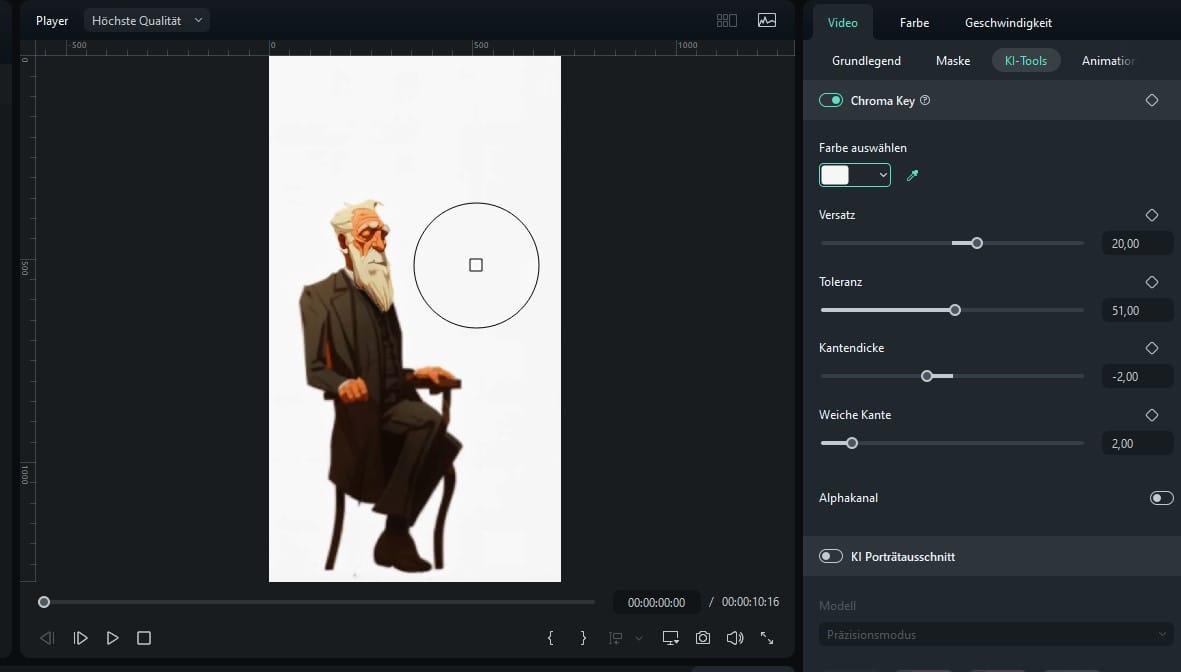

Der Workaround für diesen wichtigsten Vorgang besteht nach der KI Generierung des Videoclips aus zwei Schritten

- In einem Videoeditor Programm wie z.b Da Vince Resolve oder auch Wondershare Filmorama, den Clip hochladen und dann mit einem KI Masken Tool den Alpha Kanal erstellen und nochmal extra abspeichern.

Dafür gibt es sehr unterschiedliche Werkzeuge; da aber der Clip den wir vorher generiert haben sowieso vor einem weißen Hintergrund erstellt wird, ist es am einfachsten das Chroma Key Werkzeug zu benutzen und einfach den weißen Hinterund zu markieren.

- Den fertigen Clip mit dem Alpha in das 3d Programm, auf eine vorbereitet Fläche projzieren und abspielen lassen. Dafür muß das Alpha noch im zugehörigen Materialkanal eingestellt werden. Siehe Bild unten.

Allerdings ist es so, das jeder Clip ab Bild 1 automatisch abspielt. Man also den Abspielmoment nicht über die Timeline steuern kann. Das führt unter Umständen zu unangenehmen Überschneidungen, die das Spiel der Akteure in der Szenen unklar aussehen lässt. Die Lösung dafür besteht darin, den Clip im Editorprogramm, und natürlich bevor das Alpha generiert wird, mit Standbildmaterial künstlich auf eine bestimmte Länge zu trimmen/dehnen die nacher auch zu den anderen Bewegungen passt.

DAS PROBLEM DER FREISTELLUNG DER OBJEKTE :

Wie man sehrwahrscheinlich sehr gut sehen kann ist, das die Objekte momentan noch vor einem weißen Hintergrund angelegt sind, und es deshalb beim Chroma Keying immerwieder Stellen entstehen die auf Grund ihre Weißanteile Lücken aufweisen.

Ein klassisches Green Screening, erfordert also beim Anlegen der Vorlage für die späterere KI Bewegungsgenerierung eine anderen Hintergrund der in RGB folgende Werte hätte (0/177/64)

Die ersten Versuche damit, waren allerdings bisher eher nicht zu Gebrauchen, was die Beispiele unten ganz gut zeigen.

KI generierter Bewegungsablauf über KLING AI mit weißen und mit Greenscreen

KI generierter Bewegungsablauf über LUMA LABS Dreamachine mit weißen und mit Greenscreen

Ich denke das dieses Posting mit Sicherheit eine Fortsetzung findet. Nämlich dann, wenn die passende KI Plattform und auch der passende Workflow dafür gefunden wurde.